Кто-то бросает вам мячик и вы его ловите. Выглядит довольно просто, да?

Но на самом деле компьютерное зрение — один из самых сложных процессов, которые человек когда-либо пытался понять, не говоря уже о том, чтобы разработать. Создание машины, которая может видеть, как мы — невероятно сложная задача. Не только потому что ее трудно реализовать, но и потому что мы сами до конца не уверены, как работает компьютерное зрение.

Вернемся к примеру с пойманным мячиком. В реальности происходит примерно следующее: изображение мячика проходит сквозь глаз и попадает в сетчатку, которая проводит некий элементарный анализ и отправляет его в мозг, где зрительная кора головного мозга делает более глубокий анализ изображения. Затем изображение отправляется в другие отделы коры, где сравнивается с уже известными объектами и соотносится с какой-то категорией. Затем мозг принимает решение, как нужно отреагировать на увиденное: например, поднять руку и поймать мячик (рассчитав примерную траекторию его полета). Все это происходит за долю секунды, без каких-либо сознательных усилий, и практически всегда срабатывает без ошибок.

Поэтому создание алгоритма, аналогичного по работе человеческому зрению, не просто сложная проблема, а целый набор взаимозависимых трудностей.

Но никто не говорил, что будет легко. Кроме, пожалуй, первопроходца в области ИИ Марвина Минского. В 1966 году он велел одному из выпускников «подключить камеру к компьютеру и сделать так, чтобы тот мог описать, что видит». Прошло уже 50 лет, а мы все еще над этим работаем...

Серьезные исследования в этой области начались в 50-х годах. Было выделено три главные задачи: скопировать принципы работы человеческого глаза (сложно), скопировать устройство зрительной коры головного мозга (очень сложно), сымитировать работу остальных частей мозга (пожалуй, самая сложная проблема).

Видеть

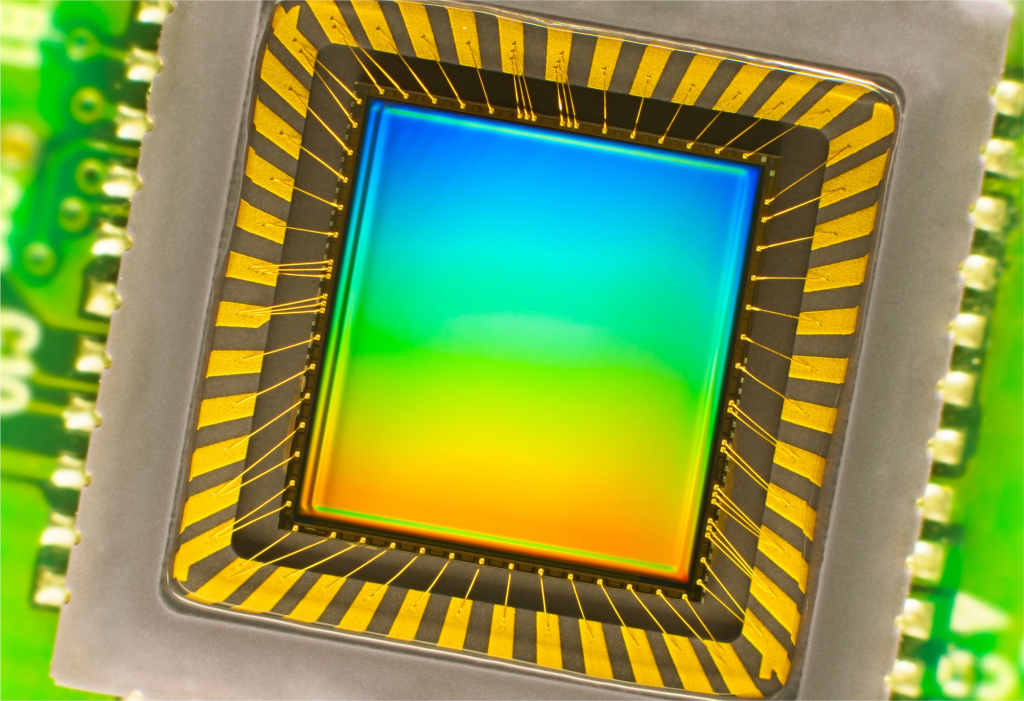

Больше всего человечество преуспело в «переизобретении» глаза. За последние несколько лет удалось создать различные сенсоры и процессоры обработки изображений, которые не только не уступают возможностям человеческого глаза, но и в некоторых случаях их превосходят. Благодаря крупным линзам, которые распознают мельчайшие фрагменты пикселя на нанометрическом уровне, точность и чувствительность современных камер стали просто невероятными. Кроме того, камеры могут записывать тысячи изображений в секунду и распознавать расстояние с высокой точностью.

Датчик изображения, который есть в любой цифровой камере. Фото: GettyImages

Но, несмотря на это, такие устройства немногим лучше камеры-обскуры 19-го века: они просто записывают распределение фотонов, исходящих из определенного направления. Даже самый хороший датчик камеры не сможет распознать летящий в нее мячик — и тем более не сможет его поймать.

Другими словами, техника жестко ограничена программным обеспечением — а это уже значительно большая проблема. Тем не менее современные технологии камер предоставляют плодотворную и гибкую платформу для работы.

Описывать

Не станем приводить тут полный курс зрительной нейроанатомии. Если вкратце, то мозг работает с помощью картин, которые, скажем так, «видит» наш разум. Большая часть мозга используется именно для зрения и этот процесс происходит даже на клеточном уровне. Миллиарды клеток работают сообща, чтобы выделить какие-то образцы из хаотического сигнала от сетчатки.

Если в нем есть какая-то контрастная линия под определенным углом или быстрое движение в каком-то направлении, нейроны начинают двигаться. Сети более высокого уровня преобразуют распознанные образцы в метаобразцы: например, «круглый объект», «движение вверх». К работе подключается следующая сеть: «круг белый с красными линиями». «Объект увеличивается в размерах». Их этих простых, но дополняющих друг друга описаний складывается вся картина.

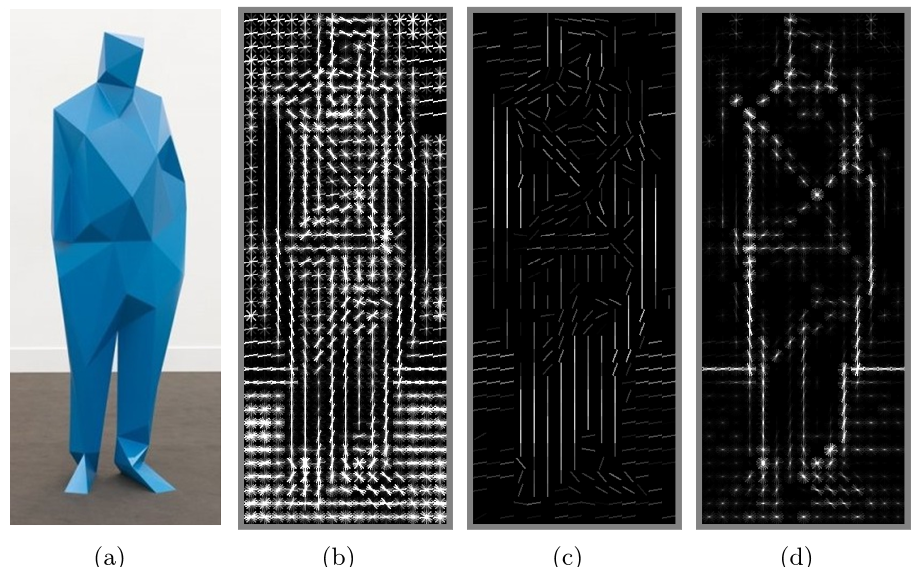

«Гистограмма направленных градиентов» находит грани и прочие параметры, работая по такому же принципу, как и области мозга, отвечающие за зрение.

Ранние исследования в области компьютерного зрения считали, что все эти взаимосвязи невероятно сложными. По мнению ученых, взаимосвязь выстраивалась «сверху вниз» — книга похожа на то-то, значит нужно искать такой-то образец. Машина выглядит так-то и двигается таким-то образом.

Для некоторых объектов в контролируемых ситуациях такой метод срабатывал. Но с его помощью невозможно описать каждый объект вокруг вас под разным углом, при любом освещении, движении и прочих факторах.

Вскоре стало ясно, что для того, чтобы система могла распознавать изображения хотя бы на уровне маленького ребенка, потребуются гораздо большие объемы данных.

Метод построения взаимосвязей «снизу вверх» оказался более эффективным. С его помощью компьютер может делать ряд трансформаций изображения, распознавать его края, содержащиеся объекты, перспективу и движение нескольких изображений и многое другое. Все эти процессы происходят благодаря множеству расчетов и статистических вычислений. Их количество равноценно попыткам компьютера сопоставить формы, которые он видит, с формами, которым его обучили.

Сейчас исследователи работают над тем, чтобы смартфоны и другие мобильные устройства могли мгновенно распознавать объекты в поле зрения камеры и накладывать на них текстовое описание. На снимке ниже представлена панорама улицы, обработанная прототипом, который работает в 120 раз быстрее, чем обычный процессор мобильного телефона.

На этом изображении компьютер распознал и выделил различные объекты, основываясь на известных ему примерах.

Фото: E-lab

Глядя на снимок, сторонники метода построения связей «снизу вверх» сказали бы: «Мы ведь вам говорили!».

Вот только до недавнего времени создание и использование искусственных нейросетей было непрактичным, поскольку для этого требовалось невероятное количество расчетов. Но развитие параллельной обработки данных привели к расцвету исследований и применения систем, пытающихся имитировать работу человеческого мозга.

Процесс распознавания образцов значительно ускорился и каждый день ученые продвигаются все дальше в этом вопросе.

Понимать

Можно создать систему, которая сможет распознавать любые яблоки — вне зависимости от того, под каким углом они показаны, в какой ситуации, в движении или состоянии покоя, целые или надкушенные. Но такая система не сможет распознать апельсин. Кроме того, она даже не сможет сказать, что вообще такое яблоко, можно ли его есть, какого оно размера и для чего оно нужно.

Проблема заключается в том, что даже хорошему оборудованию и программному обеспечению нужна операционная система.

Фото: Getty Images

Для человека такой операционной системой служат остальные части мозга: кратковременная и долгосрочная память, информация от наших чувств, внимание и восприятие, а также миллиарды жизненных уроков, полученных от бесчисленных взаимодействий с окружающим миром. Все они работают по методам, которые мы едва понимаем. А взаимосвязь между нейронами, пожалуй, является самым сложным понятием, с которым когда-либо приходилось сталкиваться людям.

На этом вопросе останавливаются как исследователи компьютерной науки, так и ученые в области искусственного интеллекта. Специалисты по компьютерной науке, инженеры, психологи, нейроученые и философы — все они с трудом могут описать, как именно работает наш мозг. Что уж говорить о том, чтобы пытаться его сымитировать?

Но это не значит, что ученые зашли в тупик. Будущее компьютерного зрения заложено в объединении специализированных систем, которые они уже создали с более широкими, которые в основном занимаются более сложными понятиями, а именно контекстом, вниманием и намерением.

Тем не менее компьютерное зрение пригождается даже в своем зачаточном состоянии. С его помощью камеры распознают лица и улыбки. Оно помогает беспилотным автомобилям считывать дорожные знаки и замечать пешеходов. Оно позволяет промышленным роботам отслеживать проблемы и передвигаться среди людей на заводе. Прежде чем машины научатся видеть, как люди, пройдет еще много лет (если это вообще когда-нибудь случится). Но учитывая, насколько это сложная задача, удивительно уже то, что они вообще умеют что-то видеть.

Материалы по теме:

Ученым удалось обойти одно из главных ограничений нейросетей

Что произойдет с чат-ботами и искусственным интеллектом в ближайшие два года?

Нейронные сети научились распознавать размытые лица на фотографиях

10 самых важных сценариев использования ИИ и машинного обучения

Нашли опечатку? Выделите текст и нажмите Ctrl + Enter

Материалы по теме

- 1 Кто публикует самые важные научные исследования в AI?

- 2 Реально смотреть на продукт и его потенциал — как в этом поможет STS

- 3 Российские школьники победили на международной олимпиаде по химии в Казахстане

- 4 Подружить физиков и биологов: как синхронизировать научную команду за 5 шагов

- 5 «Почему у нас получился диптех-стартап, а у вас не получится» — опыт компании, которая привлекла 500 млн рублей

ВОЗМОЖНОСТИ

20 апреля 2024

21 апреля 2024

21 апреля 2024