Система распознавания эмоций измерит уровень счастья в китайских офисах

Ее не обмануть дежурной улыбкой

В Китае создана система на базе ИИ, которая оценивает настроение человека по выражению его лица. Производитель утверждает, что программа поможет сократить количество конфликтов и дисциплинировать людей. Однако эксперты настроены не так оптимистично.

Представьте, что отработали уже 12 часов, чувствуете усталость и разочарование, но заставляете себя сохранять нейтральное выражение лица. Сил уже нет, но зевать, морщиться или хмуриться нельзя — за вами наблюдает всевидящее око. Оно отслеживает ваше эмоциональное состояние и обязательно сообщит, если вы выглядите злее, чем допустимо.

Это не сюжет научно-фантастического фильма или эпизода сериала «Черное зеркало». Для некоторых работников китайских технологических корпораций это уже становится реальностью.

Система распознавания эмоций ИИ, разработанная китайской компанией Taigusys, может обнаруживать и отслеживать выражение лица нескольких людей и создавать подробные отчеты о каждом человеке, чтобы фиксировать их эмоциональное состояние. Однако исследователи отмечают, что подобные системы не только часто ошибаются, но и совершенно неэтичны.

Впервые об этой системе упомянуто в майском расследовании The Guardian. Taigusys называет своими клиентами такие корпорации, как Huawei, China Mobile и PetroChina. Однако неизвестно, используется ли этот продукт в их офисах.

Издание Insider связалось с Taigusys и 36 компаниями из списка ее партнеров, но ни одна не ответила на запросы о комментариях.

Как это работает?

Макет системы распознавания эмоций, размещенный на корпоративном сайте Taigusys. Фото в тексте: Taigusys

На сайте компании сообщается, что ее система помогает «решать новые проблемы» и может «минимизировать конфликты», связанные с эмоциональным поведением.

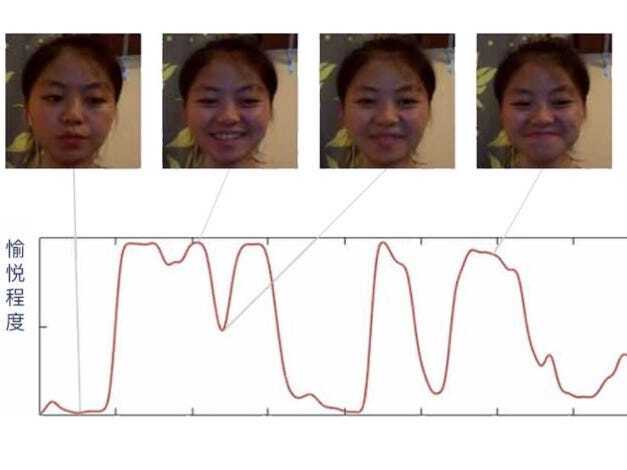

Это делается с помощью системы искусственного интеллекта, которая может одновременно считывать выражения лиц нескольких людей. Затем алгоритм изучает движения лицевых мышц и биометрические особенности каждого человека и оценивает их по нескольким шкалам, описанным Taigusys.

- Хорошие эмоции — счастье, удивление и чувства, вызванные чем-то позитивным.

- Негативные — отвращение, печаль, замешательство, презрение и гнев.

- Нейтральные — например, насколько человек сосредоточен на задании.

Taigusys утверждает: программа настолько чувствительна, что определит, если кто-то изображает улыбку.

Также она формирует отчеты о людях, в которых может порекомендовать им «эмоциональную поддержку», если маркеры негативных эмоций превышают норму.

Шкала счастья в системе распознавания эмоций. Фото в тексте: Taigusys

«Исходя из анализа черт лица человека, система может вычислить разные метрики, в том числе, насколько конфликтным, напряженным или нервным является человек. Мы также можем проанализировать эмоциональную реакцию человека и выяснить, не замышляет ли он чего-нибудь подозрительного», — говорится в описании продукта компании.

Этика и права человека

Правозащитники и технические эксперты Insider заявляют, что тренд вызывает тревогу: в основе систем распознавания эмоций лежат неэтичные, ненаучные идеи.

Видуши Марда, старший руководитель британской правозащитной программы Article 19, и Шазеда Ахмед, аспирант философии в Школе информации Калифорнийского университета в Беркли, в январе 2021 года опубликовали исследование со впечатляющими результатами. Они выявили 27 компаний в Китае, которые работали над разработкой программ распознавания эмоций, включая Taigusys.

«Если такая технология внедряется, это нарушает этические и юридические права сотрудников на рабочем месте. Даже от частных компаний ожидают уважения к неприкосновенности частной жизни и достоинству, а также права сотрудников на свободу действий и мыслей», — добавляет Марда.

Фото в тексте: Unsplash

Она отмечает, что системы распознавания эмоций основаны на слабом и не доказанном научно предположении, что выражение лица связано с внутренним эмоциональным состоянием человека.

Из-за постоянного наблюдения люди могут начать контролировать себя, чтобы обмануть систему.

Даниэль Лейфер, аналитик по европейской политике некоммерческой организации Digital civil rights Access Now, отмечает: даже если бы программа могла принести результат, она грубо нарушает права человека — право на неприкосновенность частной жизни, свободу выражения мнения и свободу мысли.

«Хуже всего то, что нарушения могут произойти несмотря на то, что распознавание эмоций невозможно с научной точки зрения. Сам факт того, что люди верят в это, а также создают и развертывают системы, претендующие на это, оказывает реальное влияние на людей, — говорит Лейфер. — Просто не используйте это, не разрабатывайте и не финансируйте».

«Общество, которое следит за нашими эмоциями, — это общество, которое будет вознаграждать одних и наказывать других. Являются ли определенные эмоции свидетельством преступности или низкой производительности?», — задает вопрос Роб Райх, профессор политологии в Стэнфорде и соавтор готовящейся книги по этике и технологиям «Системная ошибка: в чем ошиблась Кремниевая долина и как мы можем перезагрузиться» (System Error: Where Silicon Valley Went Wrong and How We Can Reboot).

«Большой Брат будет наблюдать... Результатом станет систематическое нарушение частной жизни и деградация человечества», — утверждает Роб Райх.

Лейфер добавляет, что использовать системы ИИ для наблюдения за чужими эмоциями неэтично, особенно если наблюдение ведут работодатели, полиция и правительство — те, кому подчиняются наблюдаемые.

Возможно, именно поэтому до сих пор тюрьмы являются одними из немногих рабочих мест, которые открыто признались в использовании программы.

Ранее генеральный директор Taigusys рассказал The Guardian, что системы его компании установлены в 300 тюрьмах и центрах содержания под стражей по всему Китаю. Она подключена примерно к 60 тысячам камер в таких учреждениях и помогает сделать заключенных «более послушными».

С помощью этой системы власти могут следить за людьми в режиме реального времени, 24 часа в сутки.

«Насилие и самоубийства очень распространены в центрах содержания под стражей. Даже если сейчас полиция не избивает заключенных, часто их пытаются изнурить, не позволяя им заснуть. В результате у некоторых появляются психические расстройства, и они пытаются покончить с собой. И наша система поможет предотвратить это», — отмечает Чэнь.

Многие сомневаются в самой технологии: достаточно ли она совершенна, чтобы дать корректный результат?

Десмонд Онг, доцент кафедры информационных систем и аналитики Школы вычислительной техники Национального университета Сингапура, считает, что потенциально программа могла бы помочь в «выявлении ситуаций, представляющих угрозу жизни — усталости, опьянения или психических проблем у пилотов и машинистов поездов».

Однако и он указывает, что она может стать инструментом для несправедливого и бесчеловечного обращения с людьми. Например, если в KPI сотрудников колл-центра добавят эмпатию.

Сандра Вахтер, доцент и старший научный сотрудник Оксфордского института интернета, считает: маловероятно, что алгоритм будет точно понимать сложное эмоциональное состояние людей только по выражению лица. Например, нас часто учат вежливо улыбаться, и это не всегда означает хорошее настроение или согласие.

«Применение программ для распознавания эмоций к сотрудникам также представляет угрозу для разнообразия, поскольку из-за него людям придется действовать так, чтобы соответствовать алгоритмическому стандарту. Это нарушает право свободно выражать себя», — говорит Вахтер.

Фото на обложке: LeonidKos /

-

Технологии Александр Пьянов, «Яндекс Драйв»: «Мы готовы стать агрегатором для всего рынка каршеринга» 08 апреля 2026, 12:26

-

Личное «Успешным я стану, продав бизнес и уехав в Африку реабилитировать горилл». Интервью с ресторатором Денисом Бобковым 10 апреля 2026, 17:00

-

Банки Ирина Лебедева, Т2: «Ключевой принцип — без неприятных сюрпризов» 25 марта 2026, 09:14

-

Искусственный интеллект «Идея „ИИ всех заменит“ похожа на мыльный пузырь». Прогноз на 2026 год от специалиста по будущему 24 декабря 2025, 11:29

-

Бизнес Отказ от завода и ставка на интеллект: как Катерина Карпова реанимировала PURE LOVE 02 марта 2026, 11:45

-

Бизнес Анна Симакова: «В кризис выживают крупные структуры» 20 февраля 2026, 10:06

-

Бизнес «Точно розовый?»: как Eburet из табурета-трансформера вырос в B2B-бренд, который заходит на рынок в 50 млрд ₽ 11 февраля 2026, 19:48

-

Бизнес Сергей Косинский: «Мне достался Франкенштейн, из которого попросили сделать нормального человека» 02 февраля 2026, 19:51

-

Искусственный интеллект OpenAI представила GPT-5.4-Cyber — ИИ-модель для поиска уязвимостей в ПО и защиты от киберугроз 15 апреля 2026, 18:00

-

Искусственный интеллект Названы самые популярные нейросети в России в 2026-м: в топе — Chat GPT, Claude Opus и Nano Banana 16 апреля 2026, 16:30

-

Бизнес Uber инвестирует $10 млрд в развитие роботакси — компания будет прямым конкурентом Tesla Илона Маска 16 апреля 2026, 14:40

-

Технологии Разработчик роботов Айдол выходит на рынок Японии — производитель заключил договор с местной компанией на $250 тыс. 16 апреля 2026, 12:38

-

Реклама «Яндекс Директ» обучил ИИ-ассистента запускать рекламные кампании — конверсии выросли на 30% 15 апреля 2026, 18:51

-

Россия Операторы заморозят развитие зарубежных каналов связи — это поможет ограничить рост VPN-трафика в России 16 апреля 2026, 14:00

-

Россия В работе «Ростелекома» произошёл масштабный сбой из-за DDoS-атаки — пользователи жалуются на проблемы с интернетом 06 апреля 2026, 23:59