Почему стоит беспокоиться о том, что машины умеют читать ваши эмоции

Машины теперь могут определять злость, страх, отвращение и грусть. Распознавание эмоций выросло из лабораторного проекта в индустрию, оценивающуюся в $20 миллиардов. В чем ее плюсы и минусы?

Может ли программа определять потенциальных террористов по мимике их лица и поведению? Эту гипотезу протестировала в 2003 году Администрация транспортной безопасности США (TSA) в рамках своей новой программы наблюдения SPOT.

Во время разработки программы она консультировалась с Полом Экманом, профессором психологии Калифорнийского университета, который когда-то создал свою теорию распознавания эмоций по выражениям лица.

Программу запустили в 2007 году, но она была полна проблем. Полицейские выбирали пассажиров для допроса случайно, и некоторые аресты не были связаны с терроризмом.

Экман попытался оправдаться и заявил, что его методику использовали неправильно. Однако другие предположили, что провал программы связан с устаревшей научной теорией, лежавшей в основе метода Экмана: что эмоции можно определить при помощи анализа лица.

В последние годы технологические компании стали снова использовать метод Экмана, чтобы научить алгоритмы определять эмоции по мимике. Некоторые разработчики утверждают, что автоматические системы будут работать значительно лучше людей. Тем не менее, многие эксперты, изучающие науку эмоций, обеспокоены тем, что эти алгоритмы снова потерпят неудачу.

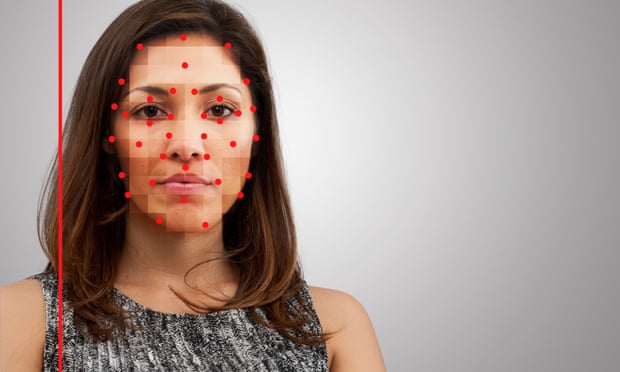

Фото: The New York Times/eyevine

Ваше лицо: индустрия, которая оценивается в $20 млрд

Для новой технологии нужны две техники: компьютерное зрение для точного определения выражения лица и алгоритмы машинного обучения для анализа эмоционального содержания.

Как правило, второй шаг основывается на технике контролируемого обучения – процесса, с помощью которого алгоритм обучается распознавать вещи, которые он видел раньше. Идея в том, что если вы покажете алгоритму тысячи изображений счастливых лиц с тегом «счастье», увидев новую фотографию счастливого лица, он отнесет ее к категории «счастье».

Доктор информатики Рана эль Калиоубай стала первой экспериментировать с этим подходом. Во время обучения в университете она разработала устройство, помогающее детям с синдромом Аспергера считывать выражения лица и реагировать на них.

В 2006 году вместе с директором лаборатории Эмоциональных вычислений в MIT Розалинд Пикард она начала работать над совершенствованием технологии. В 2009 году они основали стартап Affectiva – первый бизнес, выпустивший на рынок «искусственный эмоциональный интеллект».

Технологию распознавания эмоций используют сегодня также для мониторинга состояния водителей, UX-тестирования для видеоигр и помощи врачам оценивать благополучие пациентов.

На данный момент индустрию оценивают в $20 млрд, и рост будет только продолжаться.

База данных из 7,5 миллионов лиц из 87 стран

Прогресс технологии распознавания эмоций зависит от доступа к большему количеству качественных данных.

Фото: Дамир Саголи/Reuters

Согласно сайту Affectiva, они обладают крупнейшим в мире хранилищем данных об эмоциях: в нем содержатся около 7,5 млн лиц жителей 87 стран. Они отсортированы по 35 категориям. Сотрудники Affectiva смотрят на снимки и переводят выражения лица в соответствующие им эмоции – если они видят на фотографии нахмуренные брови, сжатые губы и выпученные глаза, они относят ее к категории «злость». Затем отсортированные данные используются для обучения алгоритма Affectiva.

Этот метод сортировки является золотым стандартом для оценки чувств; он основан на системе Emfacs, которую Пол Экман и Уоллес В. Фрисен разработали в 1980-х.

Научные корни системы уходят в 1960-е, когда Экман вместе с двумя коллегами предположили, что есть шесть универсальных эмоций – злость, отвращение, страх, счастье, грусть и удивление – которые можно проследить в любой культуре, проанализировав движение мышц на лице.

На основе этих выводов на протяжении следующих двадцати лет Экман пытался разработать свой метод распознавания эмоций. Основополагающая предпосылка заключалась в том, что если у человека вызывалась одна из этих универсальных эмоций, на его лице автоматически проявлялось соответствующее движение мышц. Даже если он пытался скрыть свои эмоции, истинное, инстинктивное чувство все равно просачивалось, и обученный специалист мог определить, что чувствует человек в данный момент.

Во второй половине XX века эта теория стала доминирующей. Экман начал продавать свою методику ЦРУ, ФБР, Службе таможенного и пограничного контроля США и Администрации транспортной безопасности.

И все же многие ученые и психологи, исследующие природу эмоций, ставят под сомнение классическую теорию Экмана и связанные с ней методы.

Особенно сильно теорию раскритиковала профессор психологии в Северо-Восточном университете Лиза Фельдман Барретт. Еще в студенческие годы она заметила, что методология, лежащая в основе исследования Экмана, ошибочна: предоставив людям заранее выбранные категории с эмоциями, Экман непреднамеренно «подготовил» их к тому, чтобы они дали определенные ответы.

Фото: John Lund/Getty Images/Blend Images

Вместе с группой коллег она проверила гипотезу Экмана; в этот раз она не дала участникам список заранее подготовленных категорий, позволив им таким образом свободно описывать переживания и чувства на изображении. Корреляция между определенными выражениями лица и эмоциями резко упала.

С тех пор Барретт разработала собственную теорию. Согласно ей, в мозгу нет универсальных эмоций, вызываемых внешними раздражителями.

«Эмоции являются сочетанием физических свойств нашего тела, мозга, культуры и воспитания, – пишет она. — Они реальны, но не в том же смысле, что молекулы и нейроны. Они реальны в том же смысле, что и деньги – их вряд ли можно назвать иллюзией; это, скорее, продукт человеческого соглашения», – добавила она.

Барретт считает, что нет смысла связывать определенные выражения лица с конкретными эмоциями во всех культурах и контекстах. В то время как один человек может хмуриться от злости, другой может улыбаться и составлять коварный план мести. По этой причине оценку эмоций лучше всего понимать как динамическую практику, включающую в себя автоматические когнитивные процессы, взаимодействие между людьми и культурную компетентность. «Это очень большая работа. Эмоции – сложная вещь», – утверждает она.

Калиоубай согласна: эмоции – действительно очень сложная вещь, поэтому ее команда в Affectiva постоянно совершенствует богатство и сложность их данных. Для обучения алгоритмов они используют видео вместо фотографий, а также экспериментируют с более контекстуальными данными, такими как голос и интонации. Она уверена, что лучшие данные приведут к более точным результатам.

Согласно Мередит Уиттейкер, директору исследовательского института AI Now, разработка алгоритмов машинного обучения, основанных на устаревшей методике Экмана, может принести серьезный социальный вред.

«Мы уже видим, как рекрутинговые компании используют эти техники для определения того, подходит кандидат на должность или нет. Или как при помощи похожих техник в школах определяют, скучает ли ученик во время уроков. Эта информация может помешать людям получить работу или повлиять на то, как к детям будут относиться в школе, а это серьезный материальный вред», – объяснила она.

Калиоубай знает об этом и воспринимает этику своей работы очень серьезно. «Очень важно вести с общественностью диалог о том, как это все работает, где это можно применять и где – нельзя», – объяснила она.

Фото: Unsplash

Калиобай также понимает важность создания разнообразных наборов данных. «В нашей базе есть изображения представителей европеоидной расы, азиатов, людей с более темными оттенками кожи и даже людей в хиджабе», – сказала она. Поэтому Affectiva собирает данные из 87 стран.

Так сотрудники компании заметили, что в разных странах выражение эмоций отличается интенсивностью и другими нюансами. Бразильцы, например, более широко и долго улыбаются, выражая счастье, а у японцев улыбка является признаком не счастья, а вежливости.

Поэтому Affectiva добавила еще один слой анализа в систему, собрав так называемые этические стандарты или кодифицированные предположения о том, как эмоция выражается в разных этнических культурах.

Но именно этот тип алгоритмического суждения, основанный на таких признаках, как этическая принадлежность, беспокоит Уиттейкер. Компании уже предлагают прогнозы вероятности того, что человек станет террористом или педофилом, а некоторые исследователи утверждают, что создали алгоритмы, которые могут определять сексуальную ориентацию человека по его лицу.

К тому же, многие исследования показывали, что технологии распознавания лиц предвзято относятся к определенным этническим меньшинствам. Одна из таких работ, опубликованная в декабре, показала, что технология определения эмоций приписывает больше негативных эмоций темнокожим людям.

В ответ на это Калиоубай сказала, что у системы Affectiva есть «классификатор этнической принадлежности», но на данный момент его не используют. Вместо этого они опираются на географию – то есть сравнивают бразильские улыбки с бразильскими, а японские – с японскими.

«Но если японец живет в Бразилии, не сочтет ли система его за бразильца и упустит нюанс улыбки из вежливости?» – спросил журналист The Guardian.

«На данной стадии технология не надежна на 100%», – ответила она.

Материалы по теме:

Китайские школьники пытаются обмануть систему распознавания лиц, чтобы поиграть в любимую игру

Технология распознавания лиц поможет фермерам выращивать здоровую рыбу

«Ваше лицо — это уже пароль»: как мы изменимся из-за технологии распознавания лиц

Системы распознавания лиц не различают азиатов. Как IT-компании с этим борются

Нашли опечатку? Выделите текст и нажмите Ctrl + Enter

Популярное

Налог на прибыль организаций

Материалы по теме

-

Пройти курс «Как открыть пункт выдачи заказов»

- 1 «Яндекс» запустил новую линейку генеративных нейросетей YandexART У платных подписчиков будет безлимит на генерацию картинок и видео 20 марта 14:56

- 2 Машинное обучение и большие данные: как они связаны? Прежде чем данные смогут «обучить» алгоритмы машинного обучения, они проходят этапы 19 марта 06:30

- 3 Топ-7 идей Data Science проектов — пет-проекты и примеры анализа данных Полезные проекты на каждый день 03 марта 18:55

- 4 Чем различаются слабый, сильный и супер-ИИ Широко распространен только один из них 27 декабря 20:50