OpenAI распустила команду по защите от искусственного интеллекта

Она занималась рисками для человечества, связанными с развитием ИИ

Уход из OpenAI главного научного сотрудника Ильи Суцкевера привел к роспуску команды, которая занималась долгосрочными рисками, связанными с развитием искусственного интеллекта. Группа, которая должна была защитить человечество от ИИ, проработала меньше года.

Как пишет CNBC со ссылкой на осведомленный источник, некоторые члены команды переводятся в другие подразделения внутри компании.

OpenAI объявила о создании команды Superalignment в июле прошлого года. В сообщении компании отмечалось, что подразделение в течение следующих четырех лет должно решить проблему управления ИИ-системами, «которые намного умнее нас».

«Но огромная сила сверхразума также может быть очень опасной и привести к лишению человечества возможностей или даже к его исчезновению», — говорилось в сообщении.

Разработчик ChatGPT планировал направить 20% имеющихся вычислительных ресурсов на работу с рисками, а возглавили команду по защите от рисков, связанных с ИИ, Илья Суцкевер и Ян Лейке.

Лейке также недавно объявил об уходе из OpenAI. Бывший топ-менеджер компании заявлял, что не разделяет взгляды руководства на приоритеты развития компании. По его мнению, OpenAI должна делать безопасность приоритетным направлением в разработке генеративного ИИ.

На этой неделе сооснователь OpenAI Илья Суцкевер написал в своем X-аккаунте, что покидает компанию после десяти лет работы. Место главного научного сотрудника займет Якуб Пачоцки, который ранее был директором по научным исследованиям.

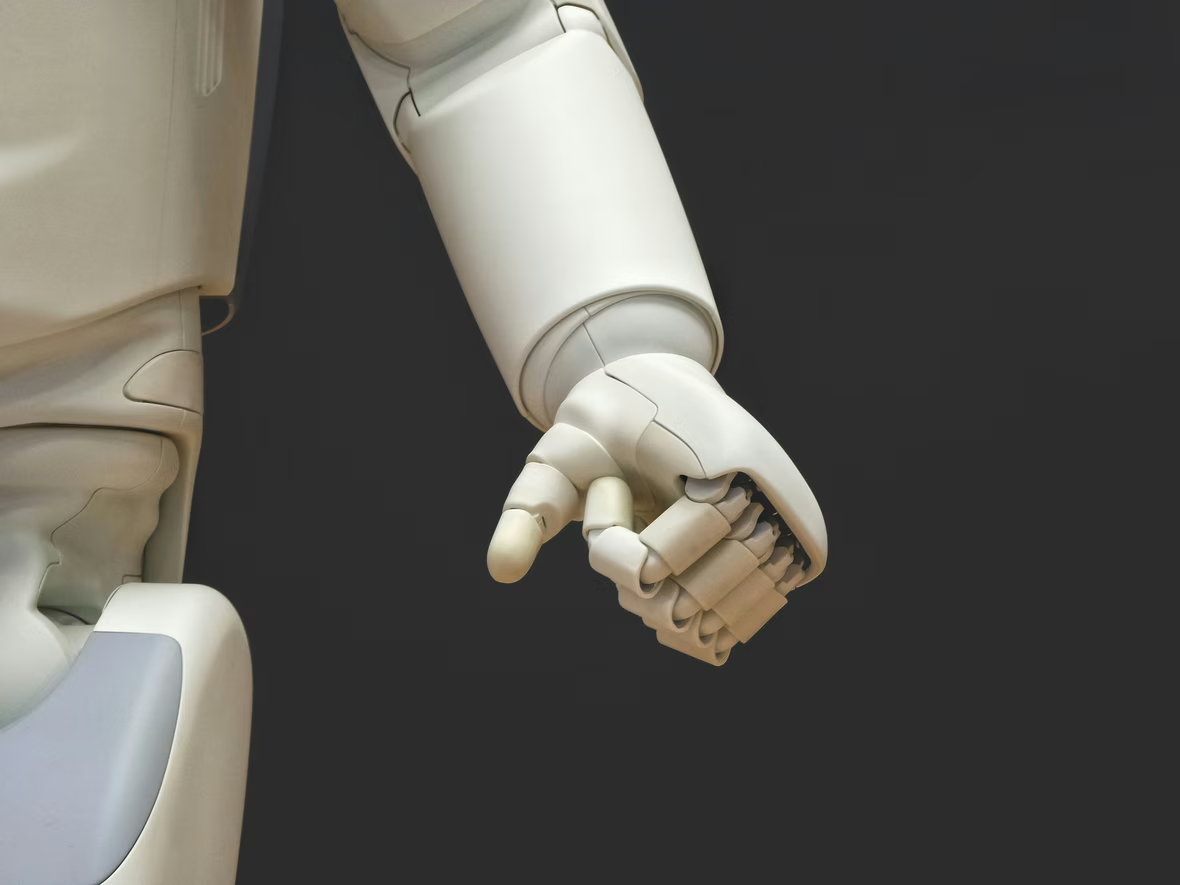

Фото: Unsplash

-

Бизнес Екатерина Лапшина: «У меня всегда был чуть больший аппетит к риску» 07 мая 2026, 16:10

-

Личное Фёдор Овчинников: «Пять месяцев в тундре — путешествие в другое измерение» 14 мая 2026, 13:18

-

Искусственный интеллект Экономика суверенитета: как финансовый сектор, промышленность и ретейл монетизируют новые технологии 28 апреля 2026, 17:00

-

Банки Владимир Скворцов: «Наша задача — снизить страховые риски клиента и быстро выплатить, если что-то случится» 19 мая 2026, 16:00

-

Технологии Александр Пьянов, «Яндекс Драйв»: «Мы готовы стать агрегатором для всего рынка каршеринга» 08 апреля 2026, 12:26

-

Искусственный интеллект Нам не нужен свой OpenAI: где России искать эффект от ИИ и что для этого делать 19 мая 2026, 11:00

-

Личное Из фарцовщика в создателя дизайн-завода Flacon: как Николай Матушевский дважды бросал свой бизнес и начинал с нуля 05 мая 2026, 12:09

-

Бизнес Российский медтех: замедление телемедицины, рост ИИ и рывок устройств 18 февраля 2026, 16:47

-

Искусственный интеллект IT-рынок без «единорогов», дефицит ЦОДов и постоянные разговоры об ИИ: чем запомнился ЦИПР в 2026 году 22 мая 2026, 23:30

-

Технологии Минпромторг может ввести требования по локализации дата-центров: аналитики предупреждают — появление ЦОД замедлится 21 мая 2026, 13:00

-

Бизнес Киноиндустрия призвала проверить сделку Warner Bros. и Paramount — отрасль опасается монополизации рынка 22 мая 2026, 20:00

-

Банки Банкоматы и платёжные терминалы будут работать без интернета — технологию разработали Минцифры и операторы связи 22 мая 2026, 18:00

-

Бизнес КАМАЗ вернулся к пятидневной рабочей неделе: компания отменила сокращённый график из-за роста заказов 22 мая 2026, 16:49

-

Бизнес Количество товаров на Wildberries растёт быстрее спроса — доля селлеров с продажами упала с 20% до 14% за год 22 мая 2026, 16:15

-

IT «Теперь все ищут не единорогов, а рабочих лошадок»: IT-рынок вошёл в зрелую стадию — инвестиции стали прагматичнее 21 мая 2026, 12:00

-

Искусственный интеллект ИИ меняет структуру бизнеса: эксперты ЦИПР — о том, как менеджеры управляют командами из ИИ-агентов 22 мая 2026, 14:30